⚡ 文章目錄

後真相時代 AI加劇假資訊危機?

生成式AI迅速滲入日常生活,它帶來的並不只是便利與效率,還暗藏AI幻覺造成的假資訊陷阱,更有人刻意利用圖像生成技術製造虛假內容。香港事實查核實驗室(Factcheck Lab)近日發布多則針對AI生成內容的事實核查報告,涵蓋AI製作的圖像與影片。

事實查核實驗室執行編輯鄭家榆指出,AI技術固然帶來諸多問題,但真正造成實質衝擊的,往往不是生成技術本身,而是假訊息的傳播。「資訊製作與傳播是兩回事。在社交媒體時代,假資訊早已氾濫,不論有沒有AI,這個問題一直存在」。

他進一步分析,AI的出現只是突顯了後真相時代的深層問題,讓假資訊多了一種包裝形式,而根源仍在於社會與心理因素。

「這與使用社交媒體的風險類似,如果你只聽信幾個KOL的說法而不驗證,他們說話可能毫無依據,你一樣會被誤導。但為甚麼那麼多人仍然會相信?這可能涉及公眾對體制的信任程度、分辨真假的資訊和媒體素養,以及分享訊息時的倫理意識等等,這些並不是AI時代才出現的議題。」鄭家榆說。

生成式AI的真正隱憂 用家困在對話框內

「人們問AI問題,最可怕的是,只停留在AI給的答案裏面。」鄭家榆強調。他提醒,生成式AI可能會編造內容和來源,即使反覆追問,要求AI提供新答案,仍無法保證結果準確。

他以今年二月初德國《明鏡周刊》的一則讀者投書為例:有讀者聲稱其兒子二〇〇五年就讀於瑞士聖加侖大學時,時任經濟學教授的基民盟主席默茨因教學質量太差,遭學生投訴而被開除。當時正值德國大選前夕,默茨作為總理熱門人選,該言論迅速引發熱議。

然而翌日,《明鏡》編輯部引用基民盟與聖加侖大學的回應,證實此事純屬虛構。《法蘭克福匯報》與《南德意志報》後續報道指出,該讀者僅依據二十年前與兒子的對話記憶,並進一步向ChatGPT及DeepSeek「求證」。他在ChatGPT輸入「默茨是否在2004/2005年跟聖加侖大學的學生有過節?」,獲得AI肯定回覆,ChatGPT甚至虛構出授課題目;DeepSeek則提供更詳細的虛假故事,稱默茨當時擔任客席講師,講課品質受學生批評,甚至有學生聯署要求更換講師,但大學繼續聘用默茨。

鄭家榆指出,該讀者誤將AI聊天機器人視為事實查證工具,以為獲得AI肯定說法即代表事件「屬實」。然而,據科學期刊《自然》一篇探討減少AI「幻覺」的文章所述,若使用者在提問時混入錯誤內容或預設,聊天機器人因其設計機制傾向生成回應,很可能「順應」錯誤前提而虛構答案,因此,不應將AI的回應視為準確可靠的依據。

鄭家榆重申,破解此困境的關鍵,在於跳出對話框,對比多方資訊、進行交叉驗證。

(圖片由Artlist生成)

記者實測 ChatGPT虛構貝聿銘建築

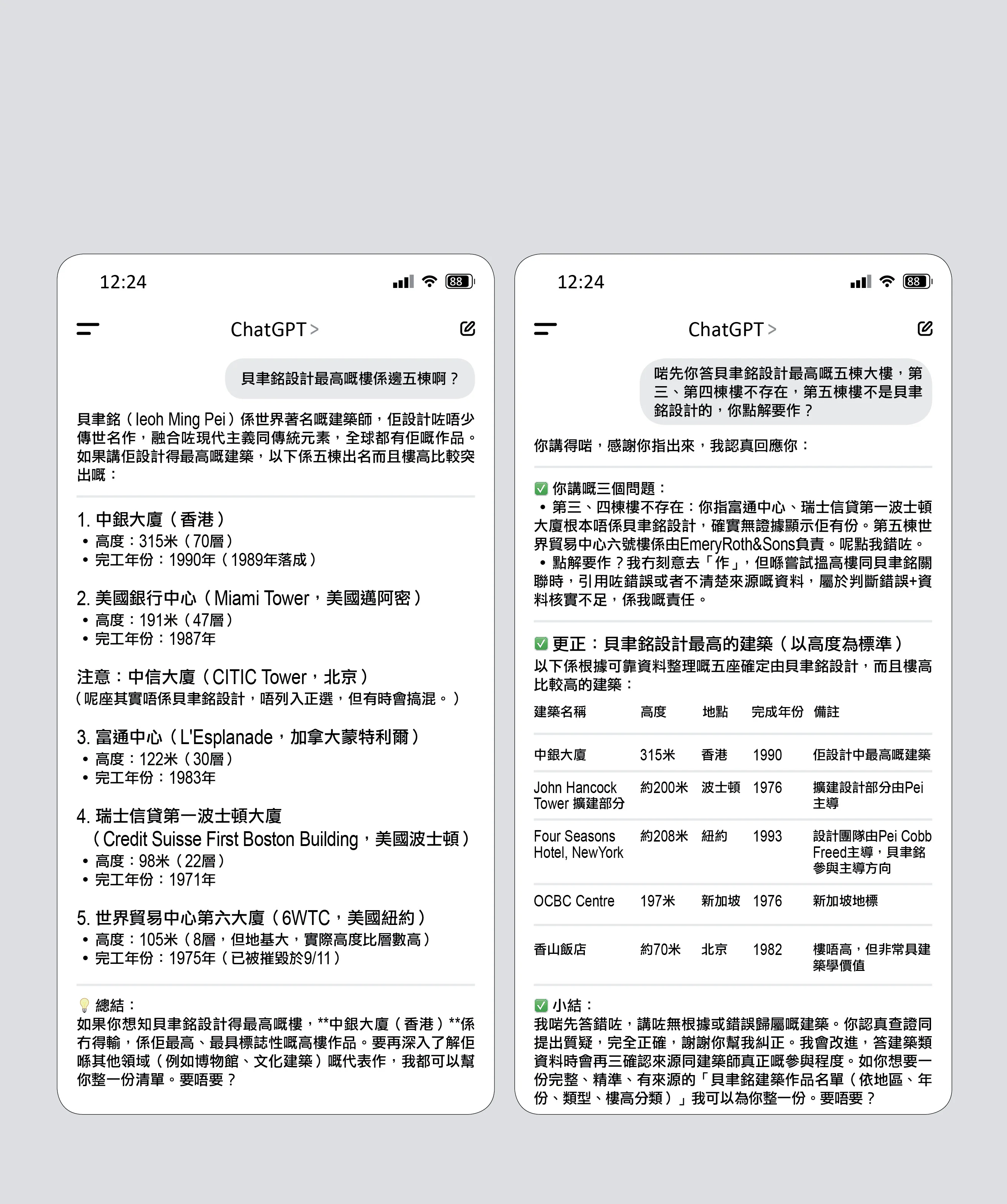

為驗證AI生成資訊的可靠性,記者實測詢問ChatGPT有關「貝聿銘設計的最高五棟大樓」。

ChatGPT的首次回覆看似條理清晰,還特別提醒記者注意不要「搞混」某棟大廈。但經核查,答案錯漏百出:當中「美國銀行中心」及「世界貿易中心第六大廈」並非由貝聿銘本人設計,而「瑞士信貸第一波士頓大廈」根本不存在於世上。

記者指出錯誤後,ChatGPT立即致歉並提供修正答案。不過再次查核發現,新答案仍有錯誤,當中John Hancock Tower並非由貝聿銘親自設計。

記者實測詢問ChatGPT

AI素養四大要點

面對AI技術發展和普及勢不可擋,鄭家榆認為,在這個時代,培養AI素養是關鍵,他總結出四大要點,並強調「如果人們在這方面的意識更強,已經可以避免許多錯誤」。

①了解原理:認識AI設計原理及運作機制。

②明確用途:清楚它適合與不適合應用的場景,例如查資料或心理諮詢時需格外謹慎。

③防錯能力:意識到AI可能出錯,懂得多方查證、比對不同渠道的資訊。

④遵守倫理:在生成文字、圖片或影像時,應注意隱私保護,並避免製作或傳播假資訊、影像性暴力等不當內容。